Prêmio: TECNOLOGIAS ASSISTIVAS

Prêmio: TECNOLOGIAS ASSISTIVAS

Utilizando Visão Computacional e Sistemas de Aprendizado de Máquina para Desenvolver um Software para Transformar Língua Brasileira de Sinais em Palavras

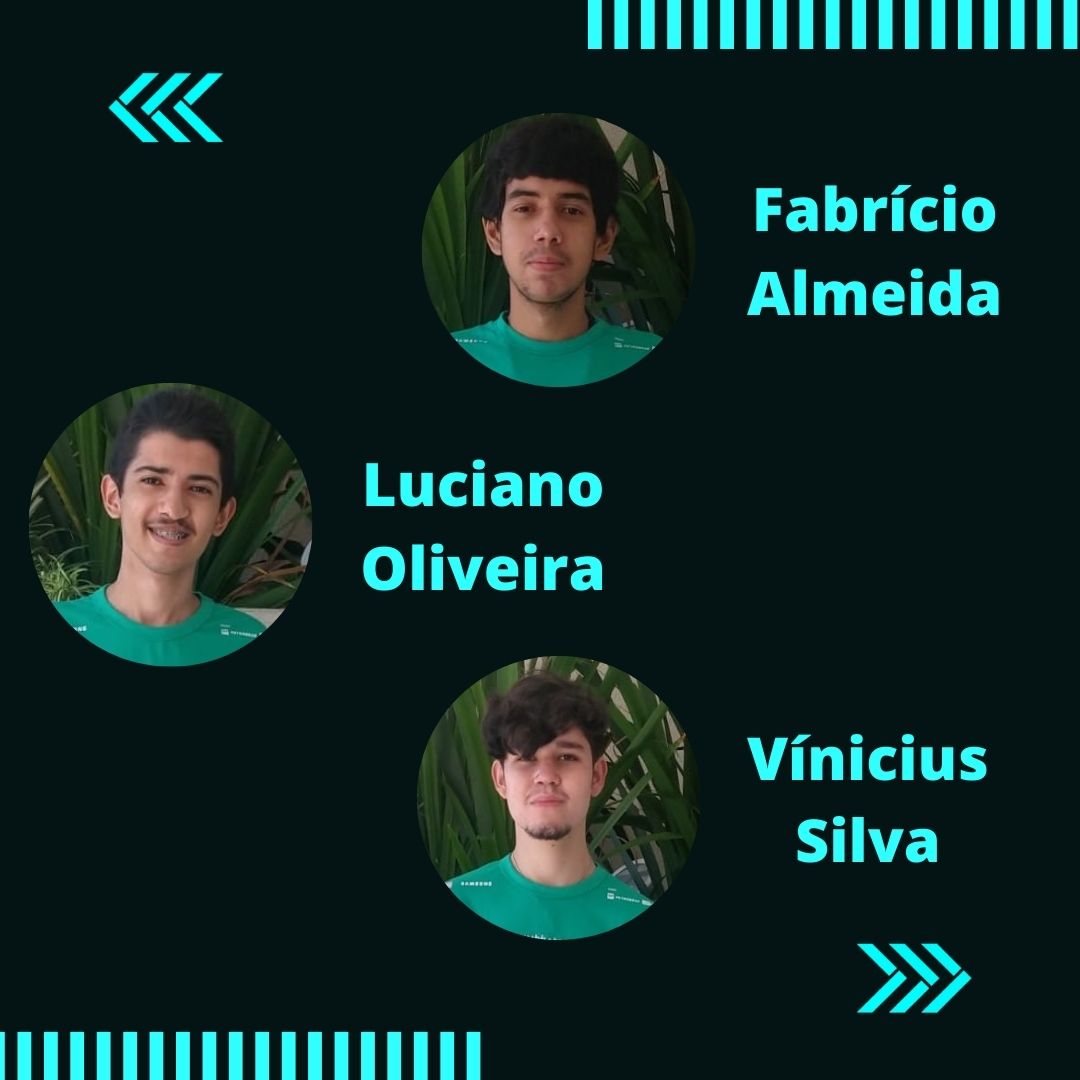

luciano dos anjos oliveira

fabricio holanda de almeida

vinicius luciano navarrete da silva

cleiton fabiano patricio - orientador(a)

rosa mitiko shimizu - coorientador(a)

Contato: luciano-oliveira2002@hotmail.com

Etec Lauro Gomes | São Bernardo do Campo - SP

Resumo. A Língua Brasileira de Sinais (Libras) é o principal meio de comunicação para surdos, mudos e deficientes auditivos, mas ela acabou ficando majoritariamente restrita a poucas pessoas, englobando mais de 5 milhões de usuários em um país com 10 milhões de surdos, correspondendo respectivamente 3% e 5% da população brasileira. Observando tal problemática, poderíamos ampliar a comunicação e acessibilidade à comunidade surda na sociedade, motivando-nos a criar uma ferramenta capaz de traduzir sinais de Libras em texto. Pesquisamos ferramentas que automatizassem o processo de tradução, como as Inteligências Artificiais (ou conhecidas como IA, podendo criar Redes Neurais computacionais, aplicando discernimento e autonomia para máquinas), Machine Learning (ou Aprendizado de Máquina, proporcionando a obtenção de maior precisão ao treinar inteligências artificiais) e o MediaPipe (uma ferramenta de código aberto capaz de gerar uma matriz gráfica baseada em 543 pontos cartesianos demarcados na face, mãos e corpo a vídeos gravados ou em tempo real). Para aplicá-las em nossa ideia, iniciamos um treinamento de 200 vídeos por sinal, utilizando o MediaPipe para identificar variações de movimentação em cada sinal de Libras, treinando em torno de 100 sinais e totalizando 20 mil vídeos treinados. Ao realizar tal procedimento, a IA pode ser capaz de, com o sinal de Libras presente no vídeo, associá-lo a sua palavra correspondente, emitindo o resultado obtido ao usuário em um arquivo de texto. Atualmente, a palavra resultante é gerada separadamente do vídeo, mas já obtivemos êxito em aplicar legendas de acordo com o sinal em alguns vídeos, mas nos dois casos, o processo é feito apenas em vídeos já gravados. Várias pessoas não tem conhecimento de Libras, faltando acessibilidade para surdos em, por exemplo, hospitais, metrôs e empresas. Com esse software, será possível levar mais facilidade de comunicação a tais lugares, auxiliando na comunicação dessa comunidade até então excluída.

Palavras-chave: Inteligência Artificial (IA), Libras (Língua Brasileira de Sinais), Inclusão.